728x90

Entropy : 정보를 표현하는데 필요한 최소 평균 자원량 (코딩을 잘한것)

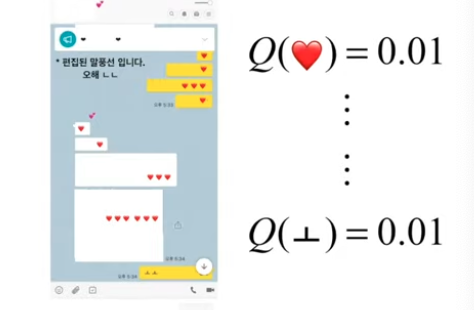

하트와 뻐큐중에 뭐가 더 엔트로피가 높을까? 하트가 높다

Cross Entropy : 동일하게 정보를 표현한다.비효율적인 것 (코딩을 못한것)

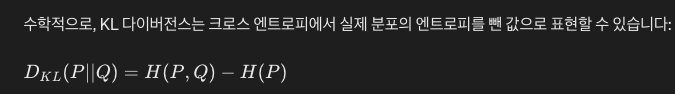

KL 다이버전스 : Entropy - Cross entorpy + 양수가 되는것

728x90

'ML' 카테고리의 다른 글

| (머신러닝) Soft Max 기법 (0) | 2022.11.09 |

|---|---|

| (머신러닝) 로지스틱 리그레션 정리 (0) | 2022.11.09 |

| 머신러닝의 정의 와 개념 및 원리 성능 향상 (0) | 2022.11.09 |

| 데이터분석한다? (0) | 2022.11.07 |